近日,AI領域的后起之秀DeepSeek因強大的性能和獨特的訓練方式,引發全球AI界熱議。與此同時,《哪吒2》憑借精美的特效和動人的故事,一路爆火,成為中國電影票房冠軍。此前,GPT-4作為OpenAI的旗艦產品,也在全球范圍內掀起了AI應用的熱潮。那么,這三者在耗電量和碳排放方面如何呢?今天,我們來算算這筆賬。

一、DeepSeek-V3訓練的碳排放

1. DeepSeek-V3訓練過程

DeepSeek-V3是一個強大的混合專家 (MoE) 語言模型。為了實現經濟高效的推理和訓練,其采用了多頭潛在注意力 (MLA) 和 DeepSeekMoE 架構,還開創了一種無輔助損失的負載平衡策略,設置了多令牌預測(MTP)。這些設計使它能支持128K長文本處理,即可以一次性處理科研論文、長篇小說等復雜的長文本;使模型同時預測多個未來的輸出token,即一次性生成多個字而非逐字生成,增強文本連貫性,大大提升代碼生成、數學推理等方面的效率和性能。

2.碳排放計算

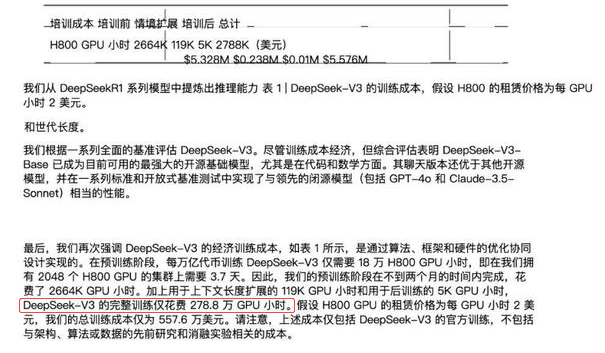

《DeepSeek-V3技術報告》部分截圖

根據官方發布的技術報告,DeepSeek-V3完整訓練時間為278.8萬H800 GPU小時。

GPU功率:假設每塊H800 GPU的功率為300瓦

單卡綜合功耗:300W(顯卡) × 1.3(散熱損耗) = 390W

總功率:2788K GPU小時 × 0.39千瓦 =1087320 kWh≈108.7萬度

全國電力平均二氧化碳排放因子:0.5366kgCO2/kWh

碳排放:1087320kWh×0.5366kgCO2/kWh= 583455.912 kg≈583.5噸

二、《哪吒2》特效制作的碳排放

1.特效制作過程

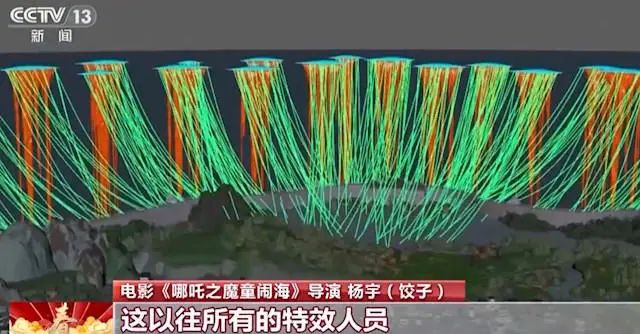

《哪吒2》的特效制作堪稱“巨量級”。導演餃子為了追求完美,把特效量加到了極致,制作量相當于兩到三部動畫電影。影片中有1948個特效鏡頭,比如海底煉獄場景里,9800條動態鎖鏈相互糾纏,每秒鐘產生27萬次物理碰撞運算。“洪流大戰”這場戲中,更是有2億多個角色出現在同一幀畫面上。

2.碳排放計算

服務器配置:假設使用1000臺服務器進行特效渲染,每臺服務器功率為1.5千瓦

渲染時間:假設每天工作12小時,整個特效制作周期為1年(365天)

總功率:1000臺 × 1.5千瓦 = 1500千瓦

總耗電量:1500千瓦 × 12小時 × 365天 = 6570000kWh=657萬度

全國電力平均二氧化碳排放因子:0.5366kgCO2/kWh

碳排放:6570000kWh ×0.5366kgCO2/kWh= 3525462 kg ≈3525噸

三、GPT-4訓練的碳排放

美國OpenAI訓練大語言模型GPT-4時,為了完成一次訓練,需要使用大約25000塊英偉達A100 GPU,并且整個訓練過程需要約三個月的時間,折合54M A100 GPU小時。它的訓練用的是?A100 80 GB顯卡,峰值功耗為400瓦,穩定工作的功耗大約為250W到300W。按300W的功耗計算,GPT-4完整訓練一次需要耗電1620萬千瓦時,換算為碳排放8692920kg,約為8692噸。

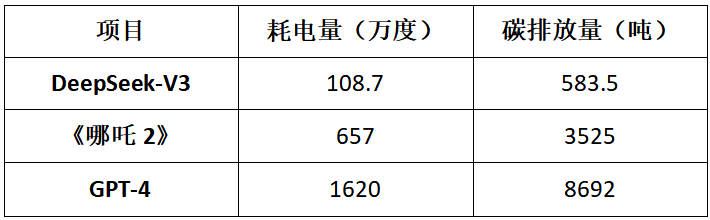

四、數據對比分析

通過上述數據可以看出,DeepSeek-V3訓練的碳排放最低,約為《哪吒2》的17%、GPT-4的7%。

DeepSeek-V3之所以有如此優秀的表現,主要得益于其高效架構設計(如多頭潛在注意力和混合專家架構)、低精度訓練以及優化的流水線并行策略。這種突破有力地證明了人工智能的進步與高能耗、高碳排并非必然掛鉤,讓我們看到了AI技術創新的無限潛力。

盡管目前AI模型訓練和動畫特效制作都是現代科技的“耗電大戶”,但DeepSeek-V3以其高效能低能耗的突破,昭示了科技進步與創新正逐步重塑這一現狀,引領行業走向更加綠色可持續的未來。

千瓦科技公眾號

千瓦科技視頻號

用手機微信掃一掃

您所計算出的排碳量為: kg

為了抵消 您的碳足跡,需種樹

棵